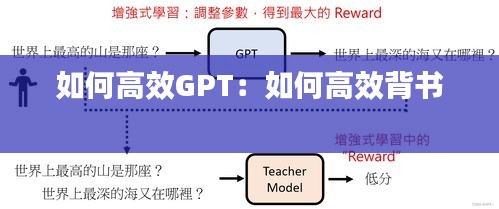

了解GPT的基本原理

要高效使用GPT(Generative Pre-trained Transformer),首先需要了解其基本原理。GPT是一种基于深度学习的自然语言处理模型,它通过预训练大量文本数据来学习语言模式和结构。这种模型的核心是Transformer架构,它能够捕捉长距离依赖关系,从而生成连贯、自然的文本。

选择合适的GPT模型

市面上有多种GPT模型,如GPT-1、GPT-2、GPT-3等。选择合适的模型对于高效使用至关重要。对于简单的应用,如文本摘要或问答系统,GPT-1或GPT-2可能就足够了。而对于更复杂的任务,如机器翻译或创意写作,可能需要使用GPT-3或更高版本的模型。

优化数据集

高质量的训练数据是GPT模型高效运行的关键。在准备数据集时,应注意以下几点:

数据质量:确保数据准确、无噪声,避免错误信息影响模型学习。

数据多样性:使用多样化的数据,涵盖不同的主题、风格和语言水平,以增强模型的泛化能力。

数据平衡:在数据集中保持不同类别的平衡,避免模型偏向某个类别。

调整超参数

超参数是影响模型性能的关键因素。以下是一些需要调整的超参数:

学习率:适当调整学习率,以平衡模型收敛速度和精度。

批处理大小:增加批处理大小可以提高内存利用率,但过大可能导致内存溢出。

序列长度:根据任务需求调整序列长度,过长可能导致内存消耗过大,过短可能影响模型性能。

使用预训练模型

预训练模型已经在大量数据上进行了训练,因此可以直接用于特定任务。使用预训练模型可以节省时间和计算资源,同时提高模型性能。以下是一些使用预训练模型的方法:

优化模型结构

Transformer模型的结构可以通过以下方式优化:

层数:增加层数可以提高模型的表达能力,但过多可能导致过拟合。

注意力机制:选择合适的注意力机制,如自注意力或交叉注意力,以增强模型对重要信息的关注。

正则化:使用正则化技术,如dropout或权重衰减,防止过拟合。

评估和调试

在训练过程中,定期评估模型性能至关重要。以下是一些评估和调试的方法:

总结

高效使用GPT模型需要综合考虑模型选择、数据准备、超参数调整、预训练模型应用、模型结构优化以及评估和调试等方面。通过不断优化和调整,可以使GPT模型在自然语言处理任务中发挥更大的作用。

转载请注明来自贝贝鲜花礼品网,本文标题:《如何高效GPT:如何高效背书 》

蜀ICP备2022005971号-1

蜀ICP备2022005971号-1

还没有评论,来说两句吧...